摘要:

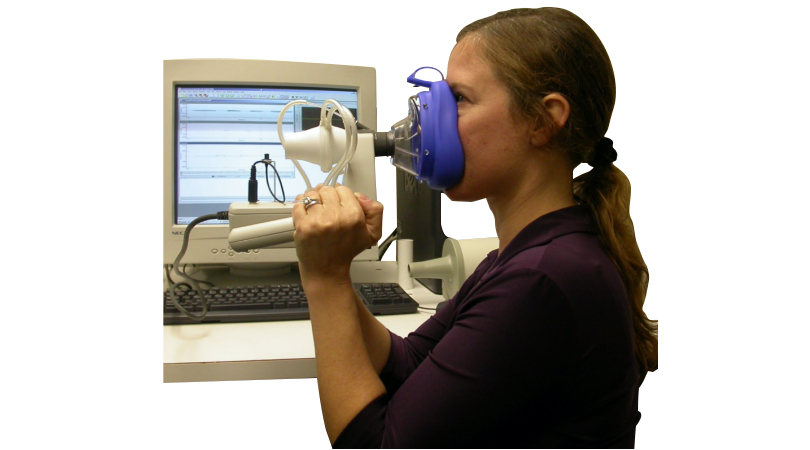

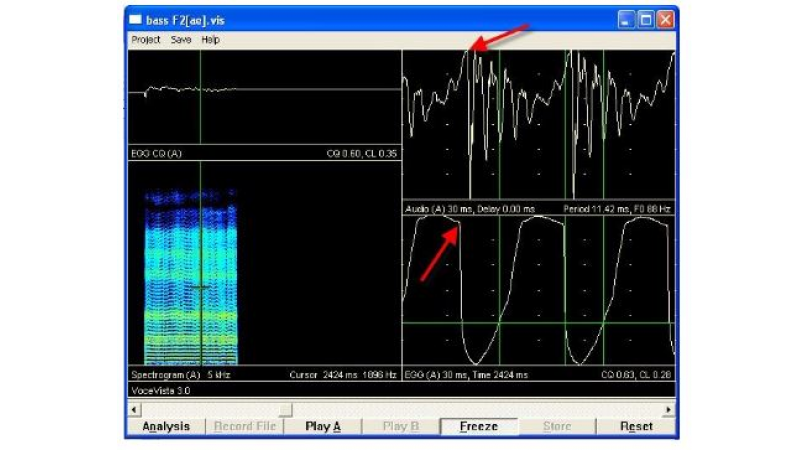

多模态情感识别在情感计算中是一个具有挑战性的课题,因为从多模态数据中提取出具有判别性的特征来识别人类情感中的细微差距仍有很高的难度。当前的研究中,基于现有的三种多模态融合的策略:特征层融合、决策层融合和模型层融合提出的算法都是偏向浅层的特征融合方案,容易造成联合特征表达的判别性不足。而设计精巧的融合模型或大型神经网络由于复杂的设计和庞大的参数,又使得特征提取的耗时过长。为了解决多模态联合特征判别性不足和特征提取耗时之间的矛盾,本文提出了一种深度模态融合的网络模型来完成多模态数据融合的情感识别任务。该模型首先利用滑动窗口将音视频信号切割成数据片段,获得最小边框标记的人脸关键帧图像和语音信号的三维梅尔倒频谱,对两路输入信号分别使用带残差的深度方向可分离的卷积核进行特征提取和特征融合,最后在联合特征上训练分类器,实现包括喜悦、悲伤、惊喜、厌恶、愤怒、恐惧和正常在内的七种不同情感的分类任务。本文在RML、eNTERFACE05和BAUM-ls音视频情感识别公开数据集上进行了训练和测试,实验结果取得了较好的分类效果。为了能够拓宽情感识别技术在各个领域中的应用,本文设计并实现了一个多模态情感识别分析系统,系统包含了数据采集输入、数据预处理、情感识别算法、数据分析计算、前端可视化和系统管理等六个模块。该系统可以根据数据模态的不同,选择不同的识别算法,实现对离线图片、音频、视频文件等多种模态数据的情感识别,支持对视频数据进行视频情感成分分析和实时视频情感识别两类任务。本文对该系统进行了详细的设计和实现,测试了系统各项功能,并将系统应用于社交媒体中的视频观点分析和医疗康复中的视频识别辅助。

年份:2019